در روزگاری که سایه تنشهای نظامی و بحرانهای امنیتی بر سر خاورمیانه و جهان سنگینی میکند، مفهوم «حقیقت» به یکی از شکنندهترین و آسیبپذیرترین مفاهیم بشری تبدیل شده است. در شرایط جنگی، اولین قربانی همواره حقیقت است؛ اما امروز، ابزارهای تحریف حقیقت دیگر به شبنامههای کاغذی یا شایعات خیابانی محدود نمیشوند. ما در عصر سلاحهای سایبری و الگوریتمهای هوشمندی زندگی میکنیم که قادرند واقعیت را با دقتی بینظیر بازتولید و تحریف کنند. در این میان، تکنولوژی «دیپفیک» (Deepfake) یا جعل عمیق، بهعنوان یکی از مخربترین ابزارهای پروپاگاندا در جنگهای شناختی مدرن ظهور کرده است؛ ابزاری که میتواند صدا و تصویر رهبران سیاسی و فرماندهان نظامی را با چنان ظرافتی جعل کند که تشخیص آن برای چشم و گوش غیرمسلح تقریبا غیرممکن باشد.

در اتمسفر ملتهب کنونی که اخبار با سرعتی سرسامآور در شبکههای اجتماعی دست به دست میشوند و افکار عمومی تشنه دریافت اطلاعات است، یک ویدیوی چند ثانیهای جعلی میتواند سرنوشت یک نبرد، اقتصاد یک کشور یا جان هزاران نفر را تغییر دهد. وقتی در میانه بحران، توانایی تحلیل منطقی و تفکر انتقادی جامعه تحت تاثیر ترس و اضطراب کاهش مییابد، دیپفیکها نه تنها بهعنوان ابزار دروغپراکنی، بلکه بهعنوان سلاحی برای فلج کردن ذهنیت جمعی عمل میکنند. در این مقاله جامع، کالبدشکافی خواهیم کرد که هوش مصنوعی چگونه از طریق دیپفیک، مرزهای واقعیت و توهم را در زمان جنگ مخدوش میکند، چه تاثیرات روانی مخربی بر جوامع بحرانزده میگذارد و ما به عنوان شهروندان عصر دیجیتال، چگونه میتوانیم این توهمات الگوریتمی را تشخیص دهیم.

سلاحهای نامرئی در جنگهای شناختی مدرن

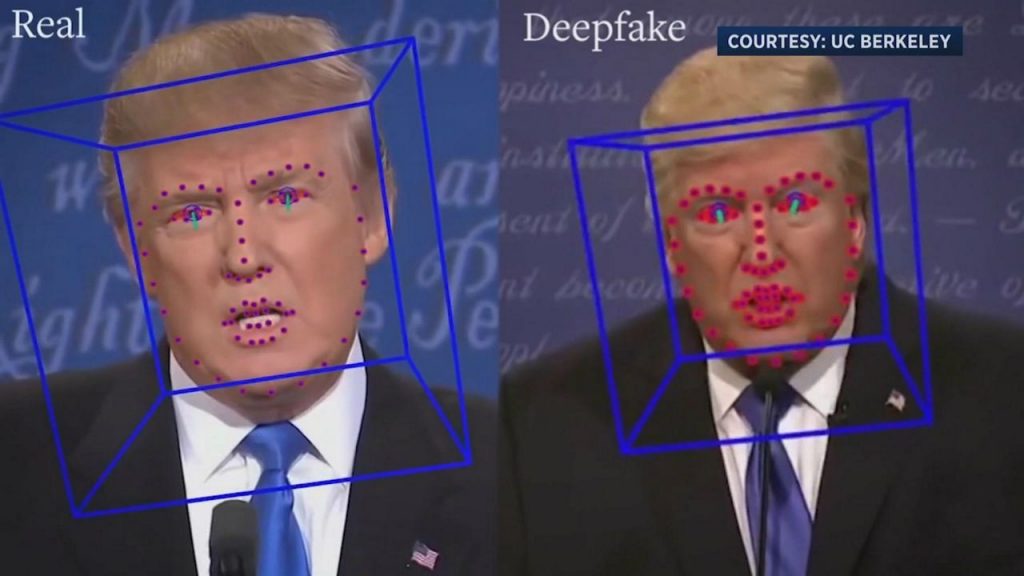

برای درک عمق فاجعهای که دیپفیک میتواند در زمان جنگ رقم بزند، ابتدا باید بدانیم این تکنولوژی دقیقا چگونه کار میکند. هسته مرکزی تولید ویدیوها و صداهای جعلی، بر پایه شبکههای عصبی مصنوعی به نام (Generative Adversarial Networks) یا به اختصار GAN استوار است. این معماری از دو الگوریتم مجزا تشکیل شده است: یک الگوریتم «مولد» (Generator) که وظیفه دارد تصاویر یا صداهای جعلی را خلق کند، و یک الگوریتم «ممیز» (Discriminator) که تلاش میکند جعلی بودن آنها را تشخیص دهد. این دو الگوریتم در یک حلقه تکرارشونده با یکدیگر رقابت میکنند. مولد آنقدر به تولید محتوا ادامه میدهد و ممیز آنقدر ایرادات آن را میگیرد تا جایی که مولد موفق میشود ممیز را فریب دهد. در این نقطه، ویدیوی جعلی به حدی از واقعگرایی میرسد که نرمافزار تحلیلی خود کامپیوتر نیز آن را واقعی میپندارد.

در گذشته، ساخت یک ویدیوی جعلی نیازمند ماهها کار در استودیوهای پیشرفته جلوههای ویژه هالیوودی بود، اما امروز با پیشرفت مدلهای یادگیری عمیق، تنها با تغذیه چند دقیقه از سخنرانیهای یک رهبر سیاسی به یک نرمافزار، میتوان مدل صوتی و تصویری او را شبیهسازی کرد. الگوریتمها با بررسی هزاران فریم از چهره فرد، میلیونها پارامتر (گاهی بیش از ۱,۰۰۰,۰۰۰ پارامتر متغیر) مانند نحوه حرکت لبها، زاویه فک، الگوهای پلک زدن و حتی چین و چروکهای ریز صورت هنگام ادای کلمات خاص را استخراج و نقشهبرداری میکنند. سپس، این نقشه حرکتی بر روی چهره یک بازیگر پایه قرار میگیرد و به اصطلاح، چهره هدف به صورت دیجیتالی روی صورت فرد دیگر دوخته میشود.

در زمینه جعل صدا (Audio Cloning) نیز وضعیت به همین منوال است. هوش مصنوعی با تحلیل طیف فرکانسی صدای شخص، لحن، سرعت ادای کلمات و تنفس او را یاد میگیرد. امروزه مدلهای تبدیل متن به گفتار (TTS) میتوانند با دریافت تنها ۳ ثانیه از صدای یک فرد، هر متن تایپ شدهای را با صدای دقیق همان شخص و با احساسات مختلف نظیر خشم، ترس یا قاطعیت بازخوانی کنند. در زمان جنگ، زمانی که یک فرمانده نظامی در حال صدور دستور عقبنشینی یا یک سیاستمدار در حال اعلام تسلیم است، این ترکیب صدا و تصویر بینقص، میتواند شیرازه مقاومت یک ملت را در عرض چند دقیقه از هم بپاشد.

وقتی چشمانمان به ما دروغ میگویند؛ درسهایی از میدانهای نبرد واقعی

استفاده از دیپفیک بهعنوان سلاح پروپاگاندا دیگر یک تئوری علمی-تخیلی نیست، بلکه در سالهای اخیر در متن بحرانهای واقعی به کار گرفته شده است. یکی از مشهورترین و خطرناکترین نمونههای این پدیده، در روزهای آغازین جنگ اوکراین رخ داد. در مارس ۲۰۲۲، ویدیویی در شبکههای اجتماعی منتشر شد که در آن، ولادیمیر زلنسکی، رئیسجمهور اوکراین، پشت تریبون ایستاده و از نیروهای مسلح کشورش میخواهد سلاحهای خود را زمین بگذارند و تسلیم ارتش روسیه شوند. این ویدیو با کیفیت قابل قبولی ساخته شده بود و در بستر پلتفرمهایی مانند تلگرام و ایکس (توییتر سابق) به سرعت وایرال شد. اگرچه مقامات اوکراینی و خود زلنسکی به سرعت وارد عمل شدند و جعلی بودن ویدیو را اعلام کردند، اما در همان ساعات اولیه، موجی از سردرگمی و وحشت در میان سربازانی که در خط مقدم مشغول نبرد بودند، ایجاد شد.

مثال بارز دیگر، استفاده از جعل صدا در مقاصد سیاسی و انتخاباتی است. در ژانویه ۲۰۲۴، در جریان انتخابات مقدماتی در ایالت نیوهمپشایر آمریکا، هزاران رایدهنده تماسهای تلفنی خودکاری (Robocalls) دریافت کردند که در آن، صدای جو بایدن با لحنی کاملا طبیعی از آنها میخواست در خانه بمانند و در رایگیری شرکت نکنند. این عملیات فریب که با استفاده از ابزارهای ارزانقیمت هوش مصنوعی ساخته شده بود، نشان داد که چگونه میتوان با جعل صدای یک رهبر، مشارکت مدنی را در مقیاس وسیع دستکاری کرد. در خاورمیانه و کشورهای درگیر تنش نیز، بارها فایلهای صوتی جعلی منتسب به مقامات امنیتی منتشر شده است که در آنها اخبار کذبی مبنی بر وقوع انفجار، سقوط ارزش پول ملی یا دستور شلیک به غیرنظامیان مخابره شده تا افکار عمومی را به سمت فروپاشی روانی سوق دهند.

این مثالها نشان میدهند که هدف اصلی تولیدکنندگان دیپفیک در زمان جنگ، لزوما فریب دادن همه افراد برای مدت طولانی نیست. آنها به خوبی میدانند که ویدیو در نهایت توسط کارشناسان راستیآزمایی خواهد شد. هدف اصلی آنها، ایجاد یک «شوک اولیه» است. در جنگ اطلاعاتی، اگر یک دروغ بتواند فقط برای ۲۴ تا ۴۸ ساعت افکار عمومی را کنترل کند، آسیب استراتژیک خود را وارد کرده است. سربازی که پست خود را ترک میکند، یا شهروندی که از ترس به پناهگاه میگریزد، بر اساس همان شوک اولیه تصمیم گرفتهاند و تکذیبیههای بعدی، اثرات مخرب آن تصمیمات آنی را جبران نخواهد کرد.

غبار جنگ و فلج تحلیلی جامعه؛ چرا فریب میخوریم؟

برای درک میزان اثرگذاری دیپفیک، باید به روانشناسی جمعی در شرایط جنگی نگاه کنیم. در زمان صلح، انسانها معمولا زمان و آرامش کافی برای بررسی منابع خبری و تفکر انتقادی دارند؛ اما در زمان وقوع جنگ یا بحرانهای ملی، پدیدهای روانشناختی به نام «اضافهبار شناختی» (Cognitive Overload) رخ میدهد. ذهن انسان در مواجهه با بمباران اخبار استرسزا، تصاویر خشن و هشدارهای امنیتی، به حالت بقا (Survival Mode) میرود. در این حالت، بخش منطقی مغز (قشر پیشپیشانی) کارکرد خود را به نفع بخش احساسی (آمیگدال) کاهش میدهد. در نتیجه، مردم به جای تحلیل منطقی اطلاعات، به صورت غریزی و احساسی واکنش نشان میدهند و تمایل دارند هر خبری که ترسهای آنها را تایید میکند، به سرعت باور کرده و برای عزیزانشان ارسال کنند تا به زعم خود، آنها را از خطر برهانند.

پدیده دیگری که کار را برای پروپاگاندای مبتنی بر دیپفیک آسان میکند، «سوگیری تایید» (Confirmation Bias) است. افراد معمولا تمایل دارند اطلاعاتی را بپذیرند که با باورهای قبلی آنها همسو باشد. اگر یک جامعه از نظر سیاسی دوقطبی شده باشد، ویدیویی جعلی از رهبر جناح مقابل که در حال اعتراف به خیانت یا فساد است، بدون کوچکترین پرسشی توسط مخالفان او پذیرفته و بازنشر میشود. سازندگان دیپفیک دقیقا دست روی همین گسلهای روانی و اجتماعی میگذارند. آنها محتوای جعلی را با در نظر گرفتن عمیقترین ترسها، نفرتها و امیدهای یک جامعه هدفگذاری میکنند تا بیشترین ضریب نفوذ را داشته باشد.

علاوه بر این، تکنولوژی دیپفیک پدیده مخرب جدیدی به نام «سود دروغگو» (Liar's Dividend) را به وجود آورده است. این مفهوم به شرایطی اشاره دارد که در آن، صرفِ وجودِ تکنولوژی جعل عمیق، باعث میشود تا رهبران و سیاستمداران بتوانند ویدیوها و اسناد کاملا واقعی از تخلفات یا اشتباهات خود را به راحتی انکار کنند و آنها را محصول هوش مصنوعی بخوانند. در واقع، دیپفیک نه تنها با تولید دروغ، واقعیت را مخدوش میکند، بلکه با ایجاد شک و تردید فراگیر، اعتبار مدارک و شواهد واقعی را نیز زیر سوال میبرد. در چنین فضایی، جامعه به مرحلهای از بدبینی مطلق (Nihilism) میرسد که در آن، شهروندان تصمیم میگیرند هیچ چیزی را باور نکنند؛ و جامعهای که نتواند بر سر مجموعهای از حقایق پایه به توافق برسد، در برابر تهاجم خارجی و فروپاشی داخلی کاملا بیدفاع خواهد بود.

پادزهر دیجیتال؛ چگونه توهمات الگوریتمی را تشخیص دهیم؟

با وجود پیشرفت خیرهکننده هوش مصنوعی، دیپفیکها هنوز بینقص نیستند و ردپاهایی از ساختگی بودن را در خود جای میدهند. برای تشخیص این ویدیوها، میتوان از ترکیبی از نشانههای بصری، شنیداری و ابزارهای تکنولوژیک استفاده کرد. اولین و سادهترین روش، دقت به جزئیات چهره انسان است که شبیهسازی آنها برای الگوریتمها بسیار دشوار است. یکی از این موارد، «پلک زدن» است. در مدلهای اولیه، افراد در ویدیوهای جعلی کمتر از حد طبیعی پلک میزدند، زیرا تصاویر آموزش داده شده به هوش مصنوعی معمولا شامل عکسهایی با چشمان باز بود. اگرچه این مشکل تا حدودی رفع شده، اما هنوز حرکت پلکها در دیپفیکها ممکن است مصنوعی، نامتقارن یا با سرعت غیرعادی باشد.

نکته مهم دیگر، بررسی نورپردازی، سایهها و بازتابها است. هوش مصنوعی اغلب در شبیهسازی دقیق فیزیک نور دچار مشکل میشود. بازتاب نور در مردمک چشم فرد باید با محیط اطراف و منبع نور محیط همخوانی داشته باشد؛ در ویدیوهای جعلی، گاهی سایههای روی صورت با زاویه تابش نور در پسزمینه در تضاد هستند. علاوه بر این، باید به مرزهای اتصال (Blending Edges) توجه کرد. معمولا در حاشیه صورت، جایی که چهره جعلی به سر واقعی متصل میشود (مانند خط رویش مو، خط فک یا گردن)، ممکن است تاری (Blurriness)، پرش تصویر (Flickering) یا ناهماهنگی در رنگ پوست مشاهده شود. همچنین، دندانها و داخل دهان یکی از پاشنههای آشیل دیپفیک هستند؛ الگوریتمها معمولا دندانها را به صورت یک بلوک سفید یکپارچه و بدون مرزهای مشخص نشان میدهند و در هماهنگی حرکت زبان با کلمات ادا شده، دچار تاخیر و خطای محاسباتی میشوند.

در بخش صدا نیز ناهنجاریهایی وجود دارد. دیپفیکهای صوتی معمولا فاقد تنفسهای طبیعی، مکثهای انسانی و تغییرات لحنی متناسب با بار احساسی کلمات هستند. صدای تولید شده ممکن است در برخی فرکانسها دارای حالت رباتیک، فلزی (Metallic) یا دارای نویزهای پسزمینه غیرعادی باشد. علاوه بر این مشاهدات انسانی، امروزه کارشناسان امنیتی از ابزارهای جرمشناسی دیجیتال (Digital Forensics) بهره میبرند. این ابزارها با تحلیل متادیتا (Metadata)، بررسی فریم به فریم برای یافتن ناهنجاریهای پیکسلی در سطح میکروسکوپی و استفاده از هوش مصنوعیهای ضد-دیپفیک (مبتنی بر مدلهای تشخیصدهنده)، میتوانند درصد جعلی بودن یک محتوا را با دقت بالایی تا حدود $۹۵\%$ تشخیص دهند.

سواد رسانهای؛ آخرین سنگر دفاعی در عصر پسا-حقیقت

در نهایت، هرچقدر هم که ابزارهای تشخیص نرمافزاری پیشرفت کنند، سازندگان دیپفیک نیز الگوریتمهای خود را ارتقا میدهند و این مسابقه تسلیحاتی دیجیتال پایانی نخواهد داشت. بنابراین، آخرین و مستحکمترین سنگر دفاعی در برابر پروپاگاندای مبتنی بر هوش مصنوعی، ذهن آگاه و سواد رسانهای شهروندان است. در شرایط بحرانی، اولین قانون این است: «قبل از اشتراکگذاری، مکث کن». ما باید بپذیریم که احساسات ما در زمان خواندن یا دیدن یک خبر شوکهکننده، دقیقاً همان چیزی است که دشمن در جنگ شناختی هدف قرار داده است. اگر ویدیویی احساس خشم، ترس شدید یا هیجان غیرقابل کنترلی در ما ایجاد میکند، این همان نقطهای است که باید زنگ خطر در ذهنمان به صدا درآید.

گام بعدی در سواد رسانهای مدرن، تقاطعگیری (Cross-referencing) اطلاعات است. آیا این ویدیوی جنجالی از رهبر سیاسی یا هر شخص دیگری، توسط خبرگزاریهای رسمی و معتبر با خطوط فکری متفاوت تایید شده است؟ آیا در سایتهای حقیقتسنج به آن پرداخته شده است؟ همچنین توجه به زمینه (Context) رویداد بسیار حیاتی است. آیا منطقی است که یک فرمانده ارشد چنین اظهارنظری را در چنین زمان و مکانی انجام دهد؟ بررسی زبان بدن در ویدیو نیز راهگشاست؛ در دیپفیکها، معمولا سر حرکات محدود و مکانیکی دارد و دستها با محتوای هیجانی صحبت همگام نیستند، زیرا هوش مصنوعی بیشتر بر روی مرکز چهره تمرکز دارد و شبیهسازی حرکات بدن برای آن بسیار پیچیدهتر است.

آموزش مداوم جامعه برای شناخت این تهدیدات، باید به بخش جداییناپذیری از پدافند غیرعامل در هر کشوری تبدیل شود. نهادهای رسانهای، دانشگاهها و پلتفرمهای اجتماعی موظفند با ارائه ابزارهای برچسبگذاری (Watermarking) برای محتوای تولید شده با هوش مصنوعی و شفافسازی در مورد منابع اخبار، به مردم در این مسیر کمک کنند. ما در حال گذار به دورانی هستیم که قانون «دیدن، باور کردن است» دیگر اعتبار ندارد. در عصر پسا-حقیقت، شکاکیت سالم و پرسشگری انتقادی، نه تنها یک فضیلت روشنفکرانه، بلکه یک نیاز اساسی برای حفظ امنیت ملی و روانی جامعه است.

جمعبندی

دیپفیکها تجلی بینقص شمشیر دولبه تکنولوژی هستند؛ دستاوردی شگرف در علم کامپیوتر که در دستان نادرست، به خطرناکترین سلاح در جنگهای روانی و پروپاگاندا تبدیل میشود. توانایی هوش مصنوعی در سرقت چهرهها و صداها، مرزهای میان حقیقت و دروغ را به باریکترین حد خود در تاریخ رسانه رسانده است. همانطور که در این مقاله بررسی شد، در شرایط ملتهب جنگی که افکار عمومی تحت فشار روانی شدید قرار دارد، یک دیپفیک موفق میتواند با دور زدن منطق و هدف قرار دادن احساسات، به سرعت به ابزاری برای ایجاد وحشت، تفرقه و فلج تحلیلی تبدیل شود.

با این حال، انسانها در برابر این تهدید الگوریتمی بیدفاع نیستند. آشنایی با مکانیسم عملکرد این تکنولوژی، شناخت نشانههای بصری و صوتی خطاهای ماشینی و از همه مهمتر، ارتقای سواد رسانهای و حفظ تفکر انتقادی در لحظات بحران، پادزهرهای اصلی مقابله با این پدیده هستند. در جهانی که چشمان و گوشهایمان ممکن است به ما دروغ بگویند، مسئولیت پاسداری از حقیقت بیش از هر زمان دیگری بر دوش تکتک شهروندان قرار دارد. آگاهی از این واقعیت که هر محتوای دیجیتالی در زمان جنگ میتواند یک تله شناختی باشد، اولین و مهمترین گام برای خنثی کردن این سلاح نامرئی و حفظ انسجام و آرامش روانی جامعه است.